Microsoft introduceert met Phi-3 een reeks “kleine taalmodellen”

De Phi-3 bestaat uit een reeks “kleine taalmodellen” ofwel SLM’s. Deze modellen bieden veel van dezelfde mogelijkheden als grote taalmodellen, maar met één belangrijk verschil: ze hebben minder rekenkracht en data nodig.

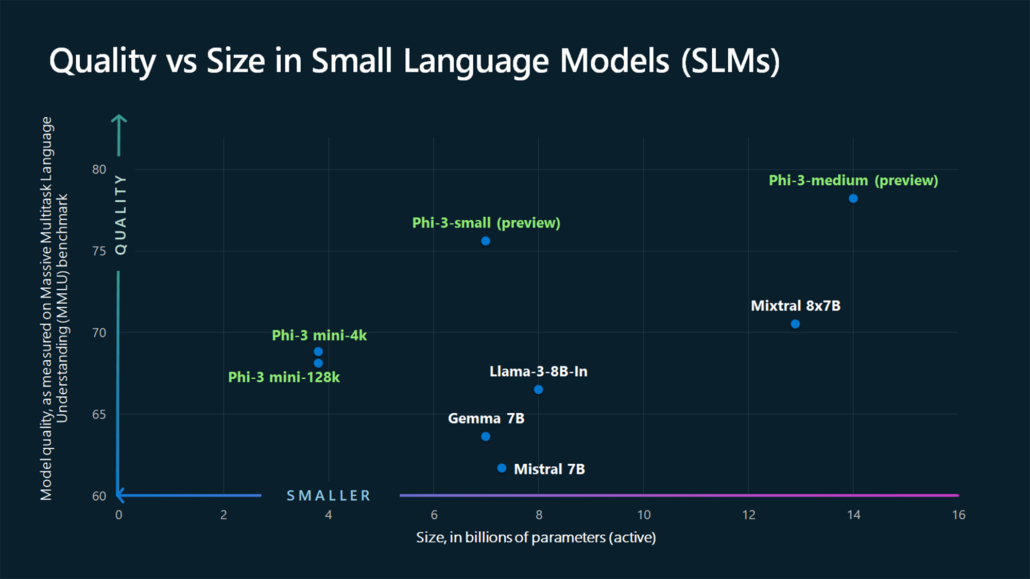

Het Phi-3-mini model presteert bijvoorbeeld beter dan modellen die twee keer zo groot zijn, aldus Microsoft.

SLM’s zijn niet bedoeld om grote modellen te vervangen, maar bieden nieuwe mogelijkheden voor bedrijven en apparaten waar de grootte belangrijk is.

Grote modellen kosten honderden miljoenen tot miljarden om te trainen en zijn duur in gebruik. SLM’s zouden deze kosten flink kunnen verlagen en nieuwe opties bieden voor AI-ontwikkelaars.

Bovendien wordt hiermee lokale AI op mobiele apparaten mogelijk. Apple onderzocht dat kleine, goed getrainde modellen op toestellen kunnen draaien en net zo goed presteren als grote modellen.

Dit betekent dat AI een onzichtbaar onderdeel kan gaan worden in tools en apparaten die we dagelijks gebruiken, wat een bredere adoptie van AI zal gaan versnellen.

Grafische illustratie die laat zien hoe de kwaliteit van de nieuwe Phi-3 modellen, gemeten aan de hand van de Massive Multitask Language Understanding (MMLU) benchmark, zich verhoudt tot andere modellen van vergelijkbare grootte. (Afbeelding ter beschikking gesteld door Microsoft)

Maak iedere week een sprong vooruit in je marketing AI transformatie

Elke vrijdag brengen wij je de meest actuele inzichten, nieuws en praktijkvoorbeelden over de impact van AI in de marketingwereld. Of je nu je marketing efficiency wilt verbeteren, klantbetrokkenheid wilt verhogen, je marketingstrategie wilt aanscherpen of je bedrijf digitaal wilt transformeren, ‘Marketing AI Friday’ is jouw wekelijkse gids.

Meld je gratis aan voor Marketing AI Friday.